지난 11편에서 Google Labs의 MusicFX 기본 기능을 소개했습니다. 텍스트 몇 줄 넣으면 루프 음악이 나오는 것, 신기하긴 했는데 솔직히 “그래서 뭘 어쩌라고?” 싶기도 했습니다. 이번에 DJ 모드라는 걸 건드려봤는데, 이건 좀 달랐습니다.

음악 이론이라고는 드럼이 ‘쿵짝’이라는 것 정도만 아는 제가 실시간으로 비트를 조절하고, 두 장르를 섞어봤습니다. 그 과정을 그대로 적어봅니다.

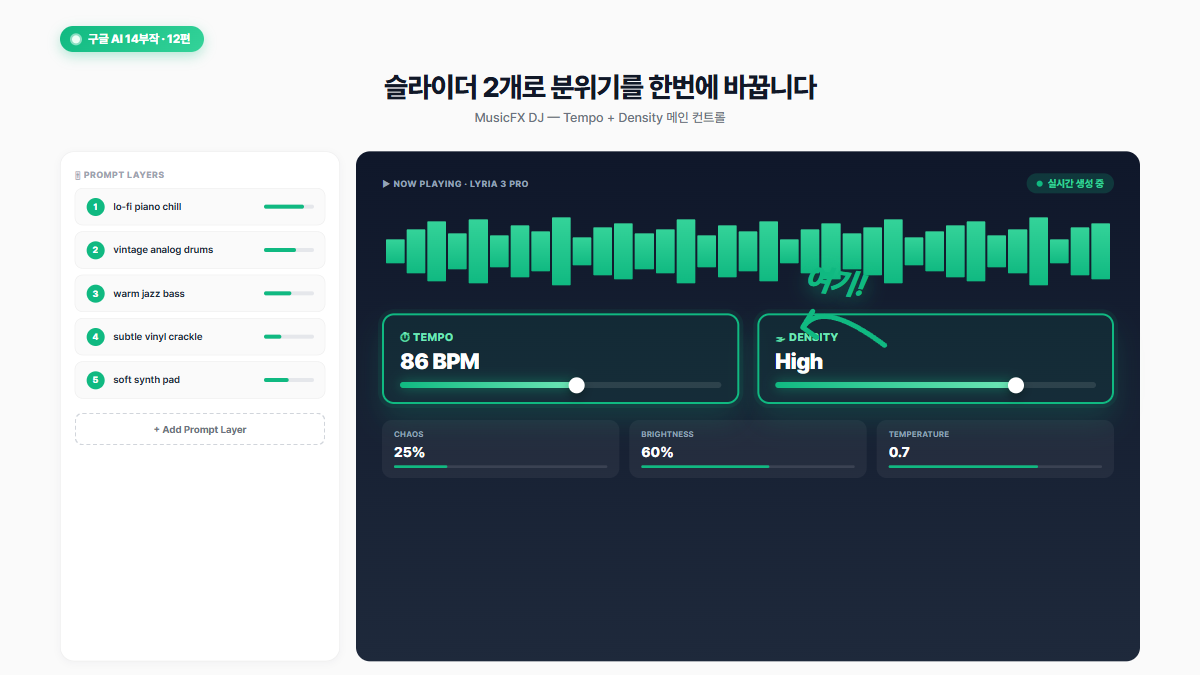

슬라이더 2개가 화면을 완전히 바꿔놨습니다

지난 편에서 소개한 MusicFX 화면에서 오른쪽 하단의 ‘DJ Mode’ 토글을 켜는 순간, 텍스트 입력창이 사라지고 슬라이더들이 나타났습니다. Intensity(강도), Density(밀도), 그리고 Chaos(예측 불가성) 등 여러 컨트롤이 있었는데, 저는 Intensity와 Density 두 개를 중심으로 만져봤습니다.

트랩 비트를 입력해둔 상태에서 재생 버튼을 눌렀습니다. 음악이 흘러나오는 동안 Intensity 슬라이더를 천천히 올려봤습니다. 드럼이 묵직해지면서 베이스가 강해졌습니다. 내리니까 배경음악처럼 잔잔해졌습니다. 멈추고 다시 재생하는 게 아니라, 손 움직이는 대로 즉시 반응했습니다.

Density는 음표 밀도 같은 느낌이었습니다. 올리면 음들이 빽빽해지고, 내리면 여백이 많아졌습니다. Intensity 높게, Density 낮게 — 강렬하지만 심플한 조합을 만들어봤습니다. 이게 되네? 싶었습니다.

두 슬라이더 조합에 따라 체감 차이가 꽤 있었습니다. 둘 다 최대로 올리면 음이 너무 쌓여서 답답해졌고, Intensity는 높이되 Density를 중간으로 유지하면 에너지는 있으면서 공간감이 살았습니다. DJ 장비를 실제로 만져보는 느낌 — 물론 훨씬 단순한 버전이지만, 손으로 직접 조절하며 찾아가는 과정이 생각보다 재밌었습니다.

국악 + 일렉트로닉을 섞었더니 의외로 됐습니다

DJ 모드의 핵심은 장르 블렌딩입니다. 화면 위쪽 장르 태그 중 두 개를 동시에 선택하고 비율을 조절할 수 있습니다.

처음엔 힙합 + 재즈로 무난하게 시작했습니다. 그다음 국악 + 일렉트로닉, 비율 4:6으로 도전했습니다.

결과가 예상 밖이었습니다. 가야금 같은 현악기 음색 아래에서 808 베이스가 쿵쿵 받쳐줬습니다. 그냥 이어붙인 게 아니라 실제로 섞인 느낌이었습니다. AI가 두 장르에서 겹치는 요소를 찾아 연결해주는 것 같았습니다.

Jazz + EDM 5:5 조합은 좀 달랐습니다. 재즈 피아노 진행에 갑자기 드롭이 들어오는 구조인데, 처음엔 “이게 뭐야” 싶었습니다. 재즈의 스윙 리듬과 EDM의 4-on-the-floor가 충돌하는 느낌이었습니다. Jazz를 3으로 낮추고 EDM을 7로 올리니까 그나마 정리가 됐습니다. EDM이 뼈대가 되고 재즈가 악센트로 올라오는 식이었습니다.

교훈 하나. 반반으로 섞는 게 항상 좋은 건 아닙니다. 한쪽을 뼈대로 잡고 나머지를 양념처럼 쓰는 게 결과물이 훨씬 자연스러웠습니다.

48kHz 모드, 이어폰으로 들으면 차이 납니다

저장하기 전에 설정을 눌러보니 High Quality Mode가 있었습니다. 켜면 48kHz 음원이 나옵니다.

같은 프롬프트로 기본 모드와 48kHz 모드 두 개를 만들어서 이어폰으로 비교해봤습니다. 결론부터 말하면 — 차이는 있습니다. 확 다르진 않지만, 하이햇이나 심벌 같은 고음역대에서 느껴졌습니다. 기본 모드에서는 좀 뭉개지는 느낌인데, 48kHz에서는 질감이 더 선명했습니다. 저음은 거의 비슷했습니다.

일반 스피커로는 차이를 못 느낄 수 있습니다. 하지만 유튜브 배경음악이나 릴스에 쓸 거라면 이 모드 켜고 저장하는 게 낫습니다. 단점은 생성 속도가 조금 느려진다는 것 정도입니다.

프롬프트를 조금만 바꿔도 결과가 확 달라집니다

MusicFX를 처음 쓰면 대부분 “calm piano music” 같은 단순한 프롬프트를 넣습니다. 나쁘지 않은 결과가 나오긴 하는데, 솔직히 그 정도면 유튜브 무료 BGM이랑 큰 차이가 없습니다. 이 도구가 진짜 빛을 발하는 건 프롬프트를 구체적으로 써줬을 때입니다.

제가 여러 번 돌려보면서 정리한 프롬프트 5대 요소가 있습니다. 이 다섯 가지를 조합하면 원하는 분위기를 꽤 정확하게 잡아낼 수 있습니다.

| 요소 | 역할 | 예시 |

|---|---|---|

| 장르(Genre) | 전체 뼈대를 잡아줍니다 | lo-fi hip hop, ambient, cinematic orchestral |

| 분위기(Mood) | 감정 톤을 결정합니다 | melancholic, uplifting, mysterious, nostalgic |

| 악기(Instruments) | 소리의 질감을 바꿉니다 | acoustic guitar, soft synth pads, muted trumpet |

| 템포(Tempo) | 에너지 레벨을 조절합니다 | slow 70 BPM, mid-tempo, fast-paced |

| 용도(Context) | AI가 전체 맥락을 이해합니다 | background for cooking vlog, meditation session |

이 다섯 가지를 한 문장에 넣으면 됩니다. 실제로 제가 써본 프롬프트 몇 개를 공유하겠습니다.

브이로그 배경음악용: “Lo-fi hip hop, warm and nostalgic mood, vinyl crackle texture, muted piano and soft drum loop, slow 75 BPM, background music for daily vlog” — 이렇게 넣으니까 카페에서 틀어놔도 어색하지 않을 정도의 곡이 나왔습니다. 단순히 “lo-fi music”만 쓸 때와는 완성도가 다릅니다.

제품 리뷰 영상용: “Cinematic ambient, confident and modern feel, deep bass synth with clean electric guitar, mid-tempo 100 BPM, tech product review background” — 테크 리뷰 영상에 깔면 딱 맞는 톤이 나옵니다. 너무 튀지 않으면서도 고급스러운 느낌입니다.

명상/릴렉스용: “Ambient drone, deeply calm and spacious, singing bowls with gentle wind textures, very slow 55 BPM, meditation and deep breathing session” — 이건 진짜 놀랐습니다. 명상 앱에 들어가도 될 수준의 사운드스케이프가 나왔습니다.

여행 하이라이트용: “Upbeat indie folk, bright and adventurous, acoustic guitar strumming with tambourine and hand claps, fast 130 BPM, travel montage highlight reel” — 여행 영상에 넣으니까 활기찬 분위기가 확 살았습니다.

여기서 Temperature 슬라이더가 하나 더 중요합니다. 앞서 Density와 Brightness를 말씀드렸는데, Temperature는 AI가 얼마나 “자유롭게” 해석할지를 결정합니다. 왼쪽으로 낮추면 프롬프트를 충실히 따르고, 오른쪽으로 높이면 예상 밖의 방향으로 갈 수 있습니다. 처음에는 낮게 깔아두고 원하는 톤을 잡은 다음, 거기서 조금씩 올려보는 방식을 추천합니다. 한 번에 확 올리면 의도와 완전히 다른 결과가 나올 수 있으니까요.

Suno, Udio 말고 이걸 써야 하는 이유

유료 AI 음악 도구와 비교하지 않을 수 없습니다. 구글이 Gemini로 GPT에 도전장을 냈던 것처럼, MusicFX도 Suno·Udio와는 다른 포지션을 잡고 있습니다.

| MusicFX DJ 모드 | Suno / Udio | |

|---|---|---|

| 가격 | 무료 (Google 계정만 필요) | 유료 (크레딧 소진) |

| 보컬 | 불가 | 가능 (가사 입력) |

| 실시간 조절 | 슬라이더로 즉시 반영 | 생성 후 수정 |

| 장르 블렌딩 | 두 장르 비율 조절 가능 | 프롬프트로 지정 |

| 결과물 수준 | 루프 배경음악 | 완성된 곡 |

“완성된 음악 작품”이 필요하면 Suno나 Udio가 맞습니다. 하지만 즉흥적으로 분위기 맞는 배경음악이 필요할 때, 실시간으로 강도를 조절하면서 영상 편집에 맞추고 싶을 때, 그리고 무료로 써야 할 때 — MusicFX DJ 모드가 유리합니다.

비교표만 보면 감이 잘 안 올 수 있으니, 무료 사용자 기준으로 좀 더 구체적으로 짚어보겠습니다.

Suno는 현재 무료 티어에서 하루 10곡까지 생성할 수 있습니다. 들어보면 퀄리티가 상당히 높은데, 문제는 무료로 만든 곡에 상업적 사용 권한이 없다는 겁니다. Pro 플랜이 월 $10(약 13,000원)이고 월 500곡까지 상업적 사용이 가능합니다. 2025년 말에 나온 v5부터는 스템 분리, MIDI 내보내기 같은 프로 기능도 들어갔습니다. 보컬 트랙만 따로 뽑거나, 생성된 멜로디를 DAW에서 편집하려는 분이라면 솔직히 Suno가 압도적입니다.

Udio는 무료 티어에서 하루 10크레딧을 줍니다. 곡 하나 생성에 보통 1~2크레딧이 드니까 실질적으로 5~10곡 정도입니다. 음질 면에서는 Suno와 거의 대등하고, 특히 보컬 표현력이 좋다는 평가가 많습니다. 다만 무료 계정은 역시 상업적 사용에 제한이 있습니다.

그런데 MusicFX는 완전 무료에 횟수 제한이 없습니다. 하루에 50곡을 만들어도 비용이 0원입니다. 구글 계정만 있으면 됩니다. 보컬 생성이나 스템 분리 같은 고급 기능은 없지만, 배경음악 용도라면 이만한 가성비가 없습니다. 유튜브 브이로그에 깔 BGM이 필요한데 매달 $10 쓸 이유가 있을까요? 정리하자면, 음악 자체가 콘텐츠인 경우에는 Suno나 Udio가 맞고, 배경음악이 필요한 경우에는 MusicFX가 합리적인 선택입니다.

2026년 들어서 구글이 진짜 밀기 시작했습니다

사실 MusicFX DJ 모드가 나왔을 때만 해도 “실험 프로젝트구나” 하는 느낌이 강했습니다. AI Test Kitchen 안에 들어있고, 인터페이스도 투박하고, 30초짜리 루프를 만드는 게 전부였으니까요. 그런데 2026년 들어서 분위기가 확 달라졌습니다.

2026년 2월, 구글이 Lyria 3를 공개했습니다. 이전 Lyria 2가 MusicFX의 엔진이었는데, 3세대에서는 Gemini 앱과 직접 연동됩니다. Gemini 채팅창에서 “30초짜리 재즈 사운드트랙 만들어줘”라고 말하면 바로 음악이 생성됩니다. 별도 사이트에 접속할 필요가 없어진 겁니다. 음질도 눈에 띄게 좋아졌고, 특히 악기 간 분리감이 이전 모델과는 차원이 다릅니다.

그리고 불과 한 달 뒤인 2026년 3월 25일, Lyria 3 Pro가 나왔습니다. 이게 진짜 게임 체인저입니다. 기존 MusicFX가 최대 70초였던 것에 비해, Lyria 3 Pro는 최대 3분까지 생성할 수 있습니다. 그것만으로도 대단한데, 더 중요한 건 곡 구조를 제어할 수 있게 됐다는 점입니다. 인트로, 벌스, 코러스, 브릿지, 아웃트로 — 이런 식으로 구간을 지정하면 AI가 자연스러운 전환까지 만들어줍니다. 30초 루프가 아니라 실제 “곡”이 나오는 겁니다.

여기에 Google Vids 연동까지 붙었습니다. 구글의 AI 프레젠테이션 도구인 Vids에서 배경음악을 직접 생성할 수 있게 된 겁니다. 발표 자료 만들면서 “이 슬라이드에 맞는 배경음악 깔아줘”가 가능해진 셈입니다. PowerPoint에서는 상상도 못 할 기능이죠.

MusicFX DJ 모드는 이 흐름의 시작점이었습니다. 지금은 실험용 놀이터처럼 보일 수 있지만, Lyria 3 Pro의 기술이 MusicFX에 반영되는 건 시간문제입니다. 구글이 AI 음악 생성을 Gemini 생태계의 핵심 기능으로 밀고 있다는 건 이제 확실합니다. 진짜 됐다. 이건 그냥 실험이 아니었습니다.

실제로 쓸 만한 데가 있습니다

| 활용처 | 왜 괜찮은가 |

|---|---|

| 유튜브 배경음악 | 저작권 프리, 분위기 맞춤 생성 |

| 릴스·쇼츠 배경 | 15~30초 클립 빠르게 생성 |

| 팟캐스트 인트로 | 에피소드마다 다른 분위기 가능 |

한계도 있습니다. 보컬 불가, 멜로디 중심의 곡 생성 어려움, 루프 기반이라 긴 곡 제작이 안 됩니다. 코딩 몰라도 앱을 만들 수 있었던 Antigravity처럼, MusicFX DJ 모드도 “음악 몰라도 비트를 만들 수 있다”는 가능성을 보여줬습니다. 다만 “배경음악 빠르게 뽑는 도구”라는 포지션을 명확히 이해하고 써야 실망이 없습니다.

저작권, 하나만 짚고 넘어가겠습니다

무료인 건 좋은데, “이거 써도 되는 건가?” 하는 의문이 당연히 들 겁니다. 저도 처음에 제일 궁금했던 부분입니다.

MusicFX로 생성한 모든 음악에는 SynthID라는 디지털 워터마크가 자동으로 삽입됩니다. 구글 딥마인드가 개발한 기술인데, 사람 귀에는 안 들리지만 알고리즘으로는 “이건 AI가 만든 음악”이라는 걸 식별할 수 있습니다. 워터마크를 제거하려고 해도 음질을 심하게 훼손하지 않는 한 남아 있도록 설계되어 있습니다.

구글은 MusicFX 생성 음악을 “royalty-free”로 소개하고 있고, AI Test Kitchen 이용약관상 개인 프로젝트에서의 사용은 허용하고 있습니다. 하지만 명시적인 상업 라이선스 문서는 아직 없습니다. “상업적으로 써도 된다”고 공식 보장한 적이 없다는 뜻입니다. 이 부분이 Suno Pro나 Udio의 유료 플랜과 다른 점입니다. 유료 서비스들은 “이 플랜에서 만든 건 상업적으로 써도 됩니다”라고 명확하게 적어놓았거든요.

그러면 유튜브 배경음악으로 쓰면 안 되느냐? 현실적으로 보면, 현재까지 MusicFX 생성 음악 때문에 유튜브에서 저작권 클레임을 받았다는 사례는 보고된 적이 없습니다. Content ID 시스템에 등록된 원곡을 학습했더라도 생성된 결과물이 기존 곡과 일치하지 않으면 자동 필터에 걸리지 않기 때문입니다. 다만 이건 “지금은 괜찮다”는 거지 “앞으로도 보장된다”는 의미는 아닙니다.

제가 권장하는 방식은 이렇습니다. 수익화하지 않는 개인 영상에는 MusicFX를 자유롭게 쓰되, 광고 수익이 붙는 채널이라면 YouTube Audio Library의 무료 음원과 병행하는 게 안전합니다. MusicFX로 분위기를 잡고, 핵심 구간에는 라이선스가 명확한 음원을 쓰는 식입니다. 구글이 Lyria 3 Pro 단계에서 상업 라이선스를 정식으로 정리해줄 가능성이 높지만, 그 전까지는 이 정도 안전장치가 필요합니다.

이 글은 구글 AI 14부작 시리즈의 12편입니다. 지금까지 NotebookLM, Gemini, AI Studio 같은 도구들을 다뤘는데, MusicFX는 그중에서도 가장 “의외의 발견”이었습니다. 구글이 AI 음악까지 이렇게 밀고 있는 줄 몰랐거든요.

배경음악 하나 때문에 유료 구독 서비스에 가입하기는 부담스럽고, 그렇다고 저작권 걱정되는 음원을 쓰기도 꺼려지는 분들이 많을 겁니다. MusicFX는 딱 그 빈틈을 채워주는 도구입니다. 완벽하지는 않지만, 무료로 이 정도 퀄리티를 뽑아준다는 것 자체가 놀라운 시대입니다.

다음 13편에서는 구글 AI 도구들을 연결해서 실제로 쓰는 방법을 이야기합니다. 시리즈 마무리까지 얼마 안 남았으니, 놓치지 마세요.