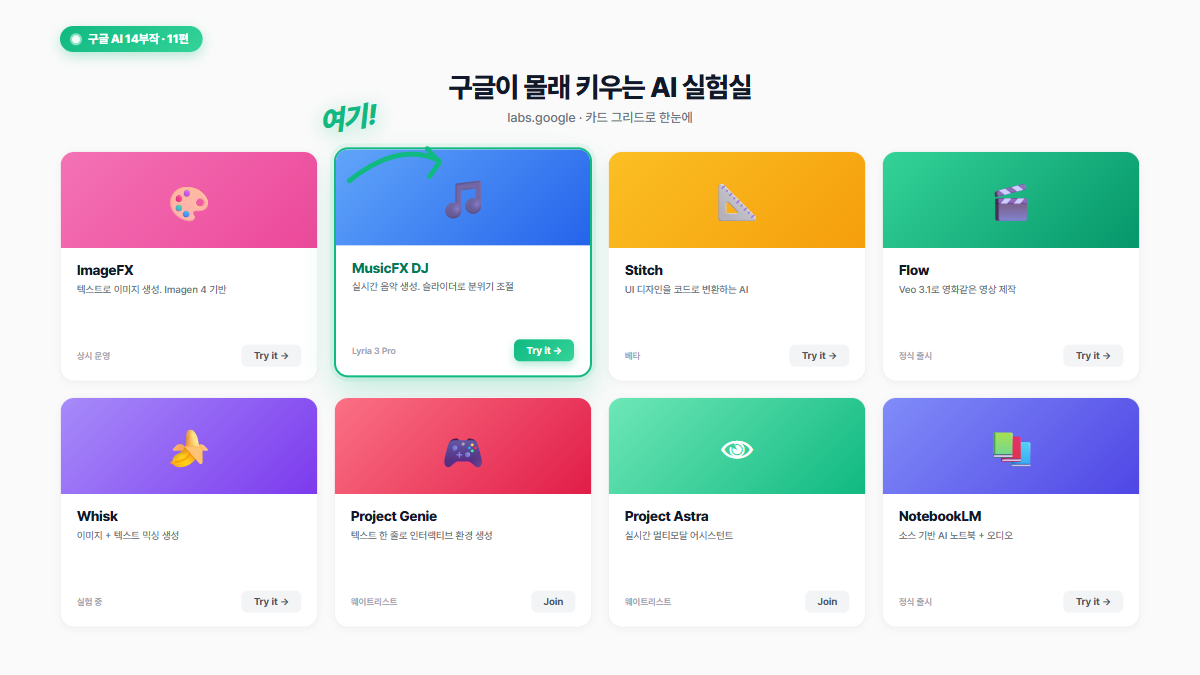

구글 AI 14부작에서 AI Studio 3연작을 끝내고 나서, 이번엔 방향을 완전히 틀었습니다. 구글이 조용히 운영 중인 실험 공간, Google Labs입니다. labs.google — 정식 서비스가 아니에요. 아직 실험 중인 AI 도구들을 일반 사용자가 먼저 써볼 수 있게 열어둔 곳입니다.

처음 들어가 보니 — 구글이 이런 것도 만들고 있었어?

MusicFX — 음악 이론 몰라도 내 분위기 음악이 나온다

MusicFX를 처음 열었을 때 입력창이 하나만 달랑 있었습니다. 텍스트 입력창. “이게 다야?” 싶었어요. 여기에 원하는 음악의 분위기를 쓰면 됩니다.

저는 이렇게 써봤습니다.

“네온 사인이 번쩍이는 서울 밤거리에 어울리는 힙합 비트, 약간 몽환적인 느낌”

재생 버튼을 누르고 5~10초 정도 지나자 음악이 나오기 시작했습니다. 살짝 흐릿한 신스 사운드에 묵직한 킥 드럼. 서울 밤 골목에서 들릴 법한 그 느낌이랄까. 저는 악기 이름도 잘 모르고, DAW는 열어본 적도 없습니다. 그냥 “이런 느낌의 음악”이라고 설명했는데, 그게 실제 음악으로 나왔어요.

두 번째 시도는 유튜브 브이로그에 쓸 배경음악이었습니다.

“한강 벤치에서 혼자 커피 마시는 느낌, 잔잔하고 좀 쓸쓸하지만 나쁘지 않은 오후”

어쿠스틱 기타에 멀리서 들리는 것 같은 피아노. 유튜브에서 무료 배경음악 찾느라 30분을 쓰는 것보다 이게 훨씬 빠르고, 원하는 분위기와 더 맞았습니다. 팁을 하나 덧붙이자면 — ‘lo-fi hip hop, 85bpm, Rhodes piano’ 식으로 장르와 악기를 영어로 구체적으로 섞으면 원하는 결과에 훨씬 빠르게 도달할 수 있어요.

구글 발표에 따르면 MusicFX는 누적 1,000만 트랙 생성을 돌파했고, 최신 업데이트 이후 선호도가 이전 대비 3배 높아졌습니다.

3번 중 1번은 틀린다 — MusicFX의 솔직한 한계

다 좋은 건 아니었습니다. 세 번 중 한 번은 원한 것과 전혀 다른 게 나왔어요. “몽환적인 힙합”을 원했는데 갑자기 밝은 팝 리듬이 나온다거나. 마음에 드는 결과를 얻기까지 4~5번 반복하는 건 일반적이었습니다. “분위기 형용사보다 구체적인 상황 묘사가 효과적”이라는 말이 딱 맞았어요.

길이 한계도 있습니다. 기본 생성이 20~30초 정도라서 긴 영상에 쓰려면 루프 설정이 필요해요. 세밀한 수정 — “이 부분 드럼 빼줘”, “여기 기타 더 살려줘” 같은 요청은 안 됩니다. 분위기 조정 수준에서 이용하는 게 맞고, 프로덕션급 기능이 필요한 작업에는 적합하지 않아요.

MusicFX만 써보고도 여기 올 가치가 있다 싶었는데 — 사실 Labs에는 이것 말고도 있었습니다. 이미지 생성 쪽에서 예상 못 했던 방식을 발견했어요.

ImageFX — 프롬프트보다 선택으로 이미지를 찾아가는 방식

이미지 생성 AI는 이미 Midjourney, DALL·E, Adobe Firefly 등 여러 개 써봤기 때문에 처음엔 “또 이미지 생성기네” 하고 가볍게 넘길 생각이었습니다. 그런데 ImageFX를 열자마자 뭔가 다른 게 있었어요.

텍스트를 입력하면 이미지 아래에 작은 버튼들이 자동으로 생성됩니다. 이게 Expressive Chips입니다. AI가 내 입력 내용을 분석해서 어울릴 만한 변주 키워드를 먼저 제안해주는 방식이에요. “카페 창가에 앉아 있는 여성”을 입력하면 “수채화 스타일”, “사이버펑크”, “필름 카메라” 같은 칩이 뜹니다. 클릭하면 그 방향으로 이미지가 바뀌어요. 프롬프트 문법을 몰라도 방향을 좁혀가는 탐색 과정이 직관적이었습니다.

“벚꽃 아래 걷는 사람”을 입력했더니 재미있는 상황이 벌어졌습니다. 첫 번째 이미지에서 손가락이 6개였어요. AI 이미지 생성에서 흔히 나오는 문제입니다. Expressive Chips로 “사실적인 사진 스타일”을 눌러봤더니 손가락은 정상이 됐는데 이번엔 배경 벚꽃이 완전히 뭉개져버렸습니다. 세 번째 시도에서야 그나마 쓸 만한 결과가 나왔어요.

2026년 현재 ImageFX에는 브러시 편집 기능이 추가됐습니다. 특정 영역을 선택한 뒤 “이 손가락 다섯 개로 바꿔줘”처럼 부분 수정이 가능해요. 처음부터 다시 생성하지 않고 문제 있는 부분만 고칠 수 있다는 건, AI 이미지 생성의 가장 큰 불편 중 하나를 해소해주는 변화였습니다. Imagen 3 탑재 이후 포토리얼리즘도 크게 향상됐어요.

SynthID — AI가 만든 것에 남는 보이지 않는 흔적

MusicFX로 만든 배경음악, ImageFX로 만든 이미지에는 공통적으로 SynthID 워터마크가 자동 삽입됩니다. 귀로 들어도 모르고, 눈으로 봐도 안 보여요. 하지만 구글의 감지 시스템은 이걸 읽을 수 있습니다. 픽셀이나 오디오 데이터 자체에 패턴이 녹아 있어 스크린샷이나 리사이즈 후에도 유지됩니다.

ImageFX로 만든 이미지를 블로그에 올릴 때 “AI generated”를 명시하는데, SynthID는 그 명시가 사라져도 이미지 자체에 흔적이 남는다는 겁니다. AI가 만든 콘텐츠가 퍼질 때 출처를 확인할 수 있는 수단 — 구글이 Labs 도구들을 단순한 장난감으로 만들지 않았다는 게 이런 디테일에서 드러나요.

2026년, Google Labs는 완전히 달라졌다

이 글을 처음 쓸 때만 해도 Google Labs는 개별 도구들이 타일처럼 나열된 실험실이었습니다. 2026년 4월 현재, 그 풍경이 상당히 바뀌었어요. 가장 큰 변화는 Flow라는 이름 아래 도구들이 하나로 합쳐지고 있다는 겁니다.

ImageFX, Whisk(이미지 무드보드 도구), 그리고 영상 생성 기능이 Flow 안으로 통합됐습니다. 2026년 2월부터 기존 프로젝트를 Flow 라이브러리로 옮길 수 있게 됐고, Whisk은 4월 30일부로 완전히 Flow에 흡수됩니다. 별도 앱으로 존재하던 도구들이 하나의 작업 공간이 된 거예요.

실제로 써보면 차이를 체감합니다. 예전에는 ImageFX에서 이미지를 만들고, 따로 다운로드해서, 다른 도구에 업로드하는 과정을 거쳤어요. 지금은 Flow 안에서 이미지를 생성하고, 그 이미지를 바로 영상의 키프레임으로 쓸 수 있습니다. 올가미(lasso) 도구로 이미지 일부분만 선택해서 “이 부분 배경을 카페로 바꿔줘”라고 자연어로 수정하는 것도 가능해졌어요.

이 통합이 의미하는 건 명확합니다. 구글이 Labs를 더 이상 개별 실험의 나열이 아니라, 크리에이터를 위한 통합 스튜디오로 키우고 있다는 거예요. 텍스트에서 이미지, 이미지에서 영상까지 — 하나의 작업 흐름 안에서 끝낼 수 있는 구조를 만들고 있습니다.

MusicFX의 진화 — Lyria 3 Pro까지 왔다

MusicFX 이야기를 좀 더 해야 합니다. 제가 처음 써봤을 때는 20~30초짜리 클립이 한계였는데, 지금은 상황이 완전히 달라졌어요.

2026년 3월, 구글 딥마인드가 Lyria 3 Pro를 출시했습니다. MusicFX의 엔진이 된 이 모델은 최대 3분짜리 트랙을 생성할 수 있어요. 30초에서 70초로, 다시 3분으로 — 이 확장이 실용성 면에서 완전히 다른 레벨입니다. 유튜브 쇼츠용 배경음악 정도가 아니라, 본격적인 영상의 배경음악으로 쓸 수 있는 길이가 된 겁니다.

더 놀라운 건 보컬과 가사가 포함된 음악을 생성할 수 있다는 점입니다. “서울 밤거리 힙합”이라고 쓰면 비트만 나오던 시절은 지났어요. 이제 노래하는 목소리가 들어간 곡이 나옵니다. 여러 언어로 가사 생성이 가능하고, 절(verse)과 후렴(chorus) 구조까지 잡아줍니다. 진짜 됐다. 텍스트 한 줄로 노래 한 곡이 나오는 시대가.

저작권 문제도 짚어야 합니다. Lyria 2 시절에는 학습 데이터의 저작권 처리가 논란이었는데, Lyria 3부터는 학습 데이터에 대한 라이선스를 취득했다고 구글이 밝혔습니다. 생성된 모든 트랙에는 SynthID 워터마크가 자동 삽입되고요. 상업적 이용을 고려한다면 이 부분이 중요한 변화입니다.

ImageFX도 Imagen 4로 세대교체

ImageFX의 엔진도 바뀌었습니다. 이 글에서 Imagen 3을 언급했었는데, 2026년 현재는 Imagen 4로 업그레이드됐어요. Fast, Standard, Ultra 세 가지 변형이 있고, 용도에 따라 속도와 품질을 선택할 수 있습니다.

체감되는 변화가 있습니다. Imagen 3 때 골치였던 손가락 문제 — 6개가 나오거나 관절이 이상한 방향으로 꺾이는 현상이 확실히 줄었어요. 텍스트 렌더링도 개선돼서, 이미지 안에 문구를 넣어달라고 했을 때 글자가 뭉개지지 않고 읽히는 수준이 됐습니다. AI 이미지 생성에서 텍스트가 정확하게 나오는 건 아직도 어려운 문제인데, Imagen 4는 이 부분에서 눈에 띄게 나아졌어요.

개인적으로 가장 유용했던 건 부분 편집의 정밀도입니다. Flow 통합 이후 올가미 도구와 결합하면서, “이 사람 머리카락 색만 바꿔줘”, “배경의 하늘을 노을로” 같은 세부 수정이 자연스러워졌습니다. 전체를 다시 생성하는 게 아니라 원하는 부분만 건드리는 방식 — 이게 실제 작업 흐름에서는 시간을 엄청나게 아껴줍니다.

Google Labs, 써야 하는 사람과 안 써도 되는 사람

솔직히 Google Labs의 도구들은 완성품이 아닙니다. 기능이 제한적이고, 결과물이 항상 원하는 대로 나오지 않고, 상업적 이용 가능 여부도 도구마다 다릅니다. 2026년 현재 유료 티어와 연동되는 방향으로 전환 중이라 무료로 계속 쓸 수 있는지는 직접 확인해야 해요.

그럼에도 지금 당장 써야 하는 사람이 있습니다.

유튜버나 콘텐츠 크리에이터, 특히 혼자 다 하는 1인 제작자라면 MusicFX는 실용적이에요. 유튜브 배경음악 찾으러 무료 음원 사이트 30분 뒤지는 것보다, 원하는 분위기를 설명하고 10초 만에 클립을 뽑는 게 낫습니다. 이미지 생성을 처음 써보는 분한테도 ImageFX부터 시작하는 걸 권해요. Expressive Chips 덕분에 “어떻게 써야 하지?”라는 막막함 없이 탐색이 됩니다.

더 크게 보면, Google Labs에서 만들어진 결과물들이 Flow로 이어지는 파이프라인이 구축되고 있습니다. ImageFX 이미지를 Flow에서 애니메이션화하고 MusicFX 사운드트랙을 붙이는 식으로 — 텍스트 한 줄에서 쇼트 영상까지 구글 생태계 안에서 완결하는 크리에이터 파이프라인이 가능해지고 있어요.

반면 안 써도 되는 사람도 있습니다.

Midjourney나 Adobe Firefly를 이미 잘 쓰고 있다면 ImageFX로 갈아탈 이유가 없습니다. 품질로는 여전히 Midjourney가 앞서요. 스템 분리, 타임라인 편집, MIDI 익스포트 같은 프로덕션급 기능이 필요하다면 MusicFX는 선택지가 안 됩니다.

지금 Google Labs의 가치는 완성된 결과물을 뽑는 데 있는 게 아니라, 앞으로 뭐가 나올지를 미리 보는 데 있습니다. 그 흐름을 먼저 경험하고 싶은 사람한테 Google Labs는 여전히 방문할 가치가 있는 곳이다.

12편에서는 MusicFX DJ 모드를 따로 다룹니다. 장르와 악기를 실시간으로 믹싱하는 인터페이스인데, 일반 사용자가 “DJ 흉내”를 내볼 수 있을 만큼 독특했어요.